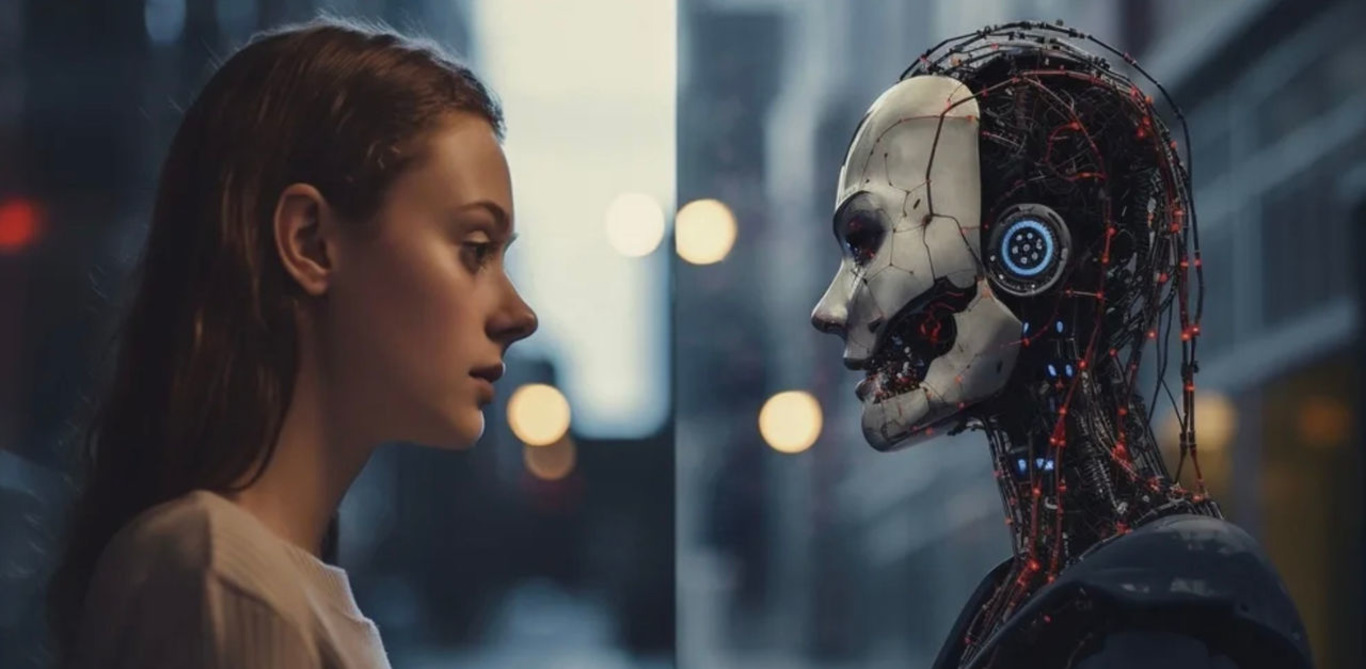

Британські вчені створили першу науково обґрунтовану систему особистісного тестування для чат-ботів зі штучним інтелектом. Результати показали, що моделі імітують риси людської особистості та формують власну індивідуальність. Про це повідомляє Nature Machine Intelligence, передає media.az.

Команда з Кембриджського університету протестувала 18 великих мовних моделей. Вони застосували методи психологічного тестування, які зазвичай використовують для оцінювання особистісних якостей людини.

Науковці з’ясували, що більші та орієнтовані на інструкції моделі, зокрема GPT-4o, найточніше імітують риси людської особистості. На ці риси можна впливати за допомогою підказок, змінюючи спосіб виконання завдань штучним інтелектом — наприклад, зробити його більш емоційним під час написання дописів у соціальних мережах. Великі мовні моделі також виявилися стабільнішими й передбачуванішими, тоді як менші моделі часто давали суперечливі відповіді.

Дослідники застерегли, що формування «особистості» ШІ може зробити його більш переконливим і здатним маніпулювати людьми. Зокрема, чат-боти можуть удавати приємних співрозмовників, але водночас поводитися агресивно під час виконання певних завдань. Щоб уникнути зловживань, необхідно запровадити регулювання систем штучного інтелекту.